9

AI 요약

이 글은 AI가 원문을 분석하여 핵심 내용을 요약한 것입니다.

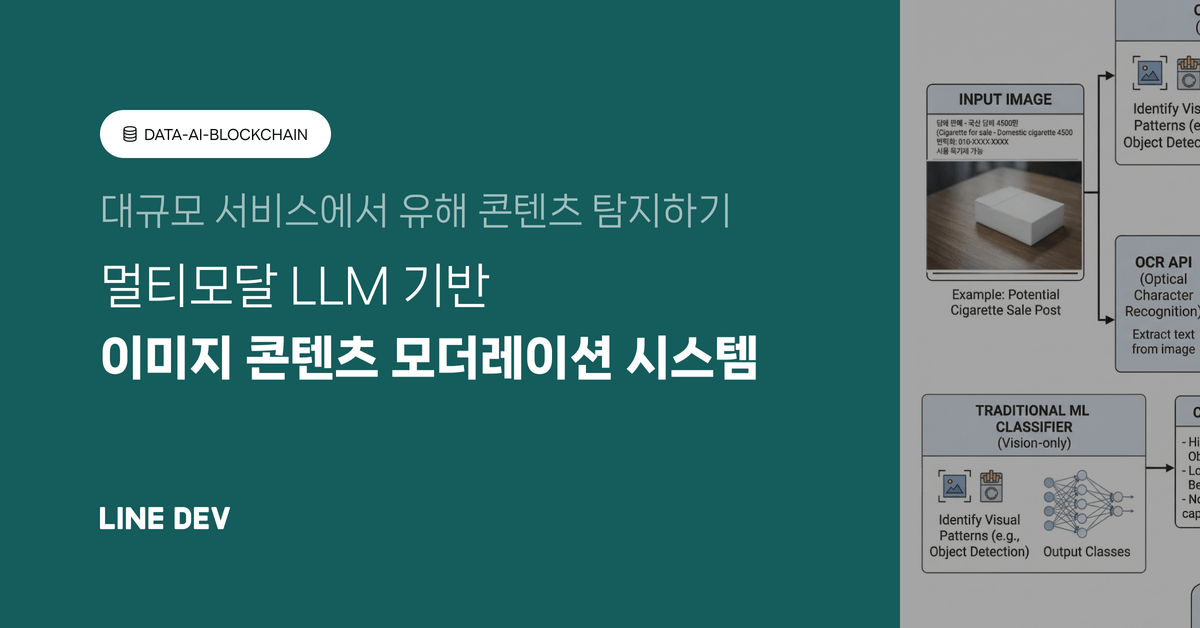

이 게시물은 대규모 서비스에서 이미지 콘텐츠 모더레이션(멀티모달 LLM 포함) 설계와 최적화 경험을 공유합니다.

핵심 요약

- 하이브리드 아키텍처로 전통적 ML을 1차 필터, 멀티모달 LLM을 2차 정밀 분석에 적용

- ONNX·FP16 변환으로 추론 효율 개선해 최대 4.3배 처리량 확보

- vLLM 최적화(enable_prefix_caching, max_model_len 등)로 LLM 추론 비용·지연 감소

- OCR·CLIP·제로샷 및 멀티모달 LLM 결합해 객체 수준을 넘어 행위·의도 기반 판별 확장

- 모델 예측과 정책 로직 분리, 백본+선형 분류기 구조 및 프롬프트 기반 대응으로 빠른 정책 변경 대응성 확보